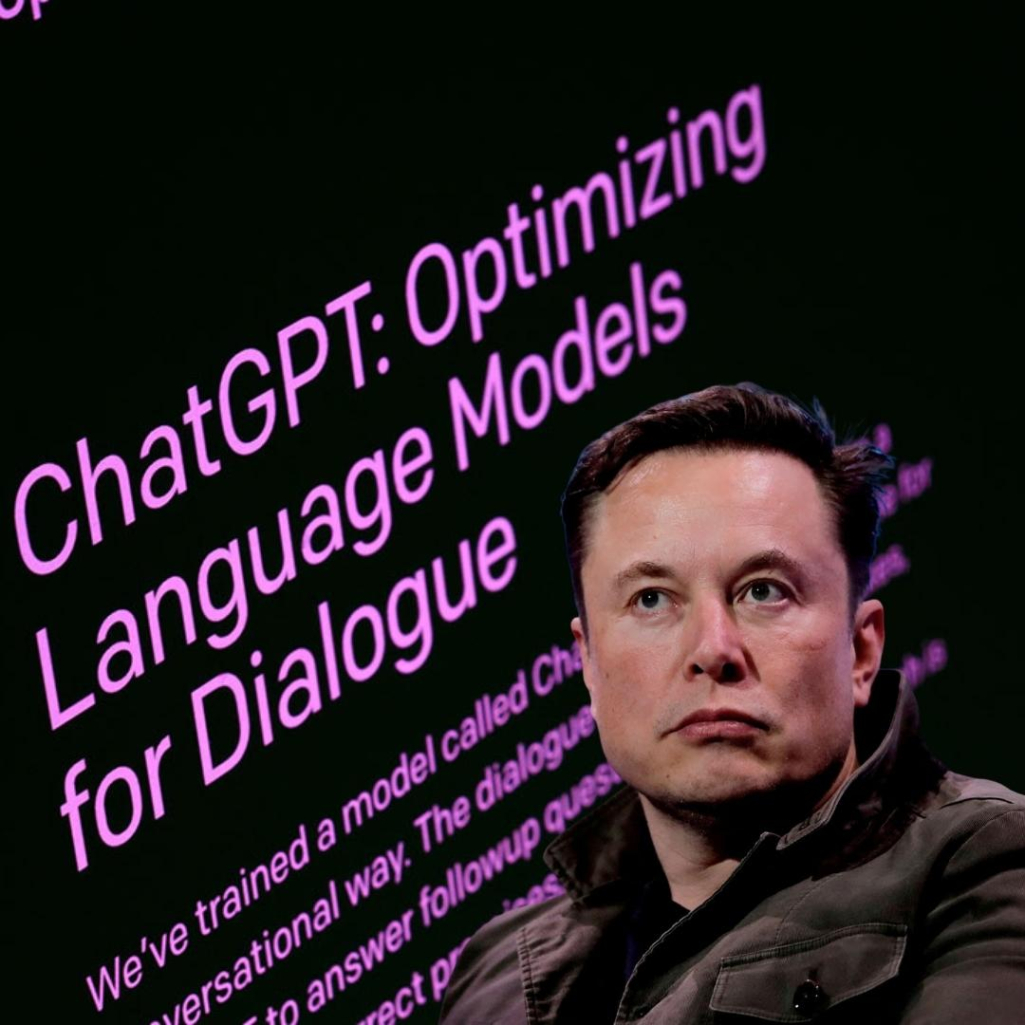

Ο Elon Musk και άλλοι ειδικοί καλούν για άμεση διακοπή του ChatGPT - Κίνδυνοι για την ανθρωπότητα

JTeam

30 Μαρτίου 2023

Ο Elon Musk όπως επίσης και ειδικοί στον τομέα της τεχνητής νοημοσύνης, υπέγραψαν μια σχετική επιστολή, στην οποία ζητούν να σταματήσει η ανάπτυξη της ΑΙ τεχνολογίας, για τουλάχιστον 6 μήνες. Στην επιστολή αυτή, επισημαίνονται οι πιθανοί κίνδυνοι από την ανάπτυξη συστημάτων τεχνητής νοημοσύνης (ΑΙ) ισχυρότερων του GPT-4 της OpenAI (το GPT-4 της OpenAI κυκλοφόρησε πρόσφατα και έχει εντυπωσιάσει τους ειδικούς με τις δυνατότητες που παρέχει).

More than 1,000 technology leaders and researchers, including Elon Musk, signed an open letter urging a pause in the development of the most powerful artificial intelligence systems, warning that AI tools present “profound risks to society and humanity.” https://t.co/6lEG5DBqOb

— The New York Times (@nytimes) March 29, 2023

Σύμφωνα με όσα γράφει η επιστολή, που εκδόθηκε από το μη κερδοσκοπικό Ινστιτούτο «Future of Life Institute» και υπογράφεται από περισσότερα από 1.000 άτομα, η ανάπτυξη των συστημάτων ΑΙ φαίνεται ότι βγαίνει εκτός ελέγχου και εγκυμονεί κινδύνους για την ανθρωπότητα.

Ο Elon Musk, είναι μεταξύ εκείνων που θέλουν να σταματήσει η εκπαίδευση των συστημάτων τεχνητής νοημοσύνης που υπερβαίνουν ένα ορισμένο επίπεδο ικανοτήτων, για τουλάχιστον έξι μήνες. Επίσης ο συνιδρυτής της Apple, Stephen Wozniak, και ορισμένοι ερευνητές της DeepMind υπέγραψαν επίσης την επιστολή.

Η OpenAI, η εταιρεία που βρίσκεται πίσω από το ChatGPT, κυκλοφόρησε πρόσφατα το GPT-4, ένα σύστημα τεχνολογίας, που «διαβάζει» εικόνες και σχολιάζει τμήματά τους.

«Τα συστήματα τεχνητής νοημοσύνης με νοημοσύνη ανταγωνιστική προς την ανθρώπινη μπορούν να θέσουν βαθύτατους κινδύνους για την κοινωνία και την ανθρωπότητα», αναφέρoυν οι ειδικοί.

«Η προηγμένη τεχνητή νοημοσύνη πρέπει να αναπτύσσεται με προσοχή». «Αλλά, αντίθετα, τους τελευταίους μήνες τα εργαστήρια τεχνητής νοημοσύνης έχουν εγκλωβιστεί σε έναν ανεξέλεγκτο αγώνα δρόμου για την ανάπτυξη όλο και πιο ισχυρών ψηφιακών μυαλών που κανείς -ούτε καν οι δημιουργοί τους- δεν μπορεί να κατανοήσει, να προβλέψει ή να ελέγξει αξιόπιστα».

Η επιστολή προειδοποιεί ότι η τεχνητή νοημοσύνη θα μπορούσε να πλημμυρίσει τα κανάλια πληροφοριών με παραπληροφόρηση και να αντικαταστήσει τις θέσεις εργασίας με αυτοματοποίηση.

Επίσης αναφέρεται πρόσφατη έκθεση της επενδυτικής τράπεζας Goldman Sachs, η οποία δηλώνει ότι ενώ η τεχνητή νοημοσύνη είναι πιθανό να αυξήσει την παραγωγικότητα, εκατομμύρια θέσεις εργασίας θα μπορούσαν να αυτοματοποιηθούν. «Θα πρέπει να αναπτύξουμε μη ανθρώπινα μυαλά που θα μπορούσαν τελικά να μας ξεπεράσουν και να μας αντικαταστήσουν;» δηλώνουν χαρακτηριστικά οι ειδικοί.

Επομένως ζητείται από τα εργαστήρια τεχνητής νοημοσύνης «να διακόψουν αμέσως για τουλάχιστον έξι μήνες την εκπαίδευση συστημάτων τεχνητής νοημοσύνης ισχυρότερων από το GPT-4». Εάν μια τέτοια καθυστέρηση δεν μπορεί να τεθεί σε ισχύ γρήγορα, οι κυβερνήσεις θα πρέπει να παρέμβουν και να θεσπίσουν μορατόριουμ, αναφέρει η επιστολή, και προσθέτει ότι θα χρειαστούν επίσης «νέες και ικανές ρυθμιστικές αρχές, αφιερωμένες στην τεχνητή νοημοσύνη».

Μέχρι στιγμής, η OpenAI δεν έχει σχολιάσει δημοσίως τα σχετικά νέα.

Αληθινές ιστορίες, βαθιά θέματα, καθημερινή έμπνευση. Ακολούθησε το JennyGr στο Google News.